很多人搭建好QQ机器人后跟我反馈,说比官网速度要慢,是不是网络原因?下面我给出我的观点

QQ机器人比ChatGPT官网上给人的感觉是回复慢,这是事实,原因有以下几点:

- 国内网络原因,连接官方接口速度确实慢

- 最近ChatGPT爆火,用户快速增加,官方接口压力倍增,相对于刚刚开放时速度也确实慢了

- 官网使用流的方式展示回复内容(也就是一个字一个字的往外跳)

前两点我想大家都能懂,第三点是什么鬼?什么是流? 其实,你不是程序员不用知道什么是流,你可以把他想象成管道里的水,而网络就是管道。 管道越大(网络越好),里面同体积的水(数据流)是不是就流的更快? 这就是第1个原因的解释。

水是从哪里来的?当然是水龙头(官方的服务器),同一时间有很多人想把自己的水管接在官方的水龙头上取水(数据流),而官方的水龙头数量有限,只能轮着用,这个时候是不是就要排队?这个就是第2个原因的解释。

第3个原因的可以这样理解,官方水龙头里的水(数据流,也就是ChatGPT回答你的内容)顺着你的管道流进你的桶,然后QQ机器人再把桶拿给你看。这个过程,机器人为了让你一次看到整个回复,所以它要等官方的水全部流进桶后才会把桶拿给你。而官方的网页,没有机器人给你递桶的过程甚至没有桶,网页直接把水一点一点喷出来给你看(这就是为什么你看到的字是一个一个的往外蹦了)。

这种数据展示形式的好处就是当你看到第一个字的时候你就好主观的认为ChatGPT已经回答完了,其实它只是回答了第一个字而已,其他字要么还在路上,要么还在它脑子里。

其实这种形式展示数据,代码里也可以实现

这样使用流来展示数据是不是这样看起来速度快多了? 但是试想一下,你和别人通过QQ或微信交流,你是希望对方把一段话写完再发送还是一个字一个字的给你发?答案显而易见吧。 所以QQ机器人、微信机器人会等数据流都收到之后,才把数据发送给你看,不然不就成了一个字一个字给你发了吗。

这也就是第3个原因的解释。

个人理解,欢迎指正

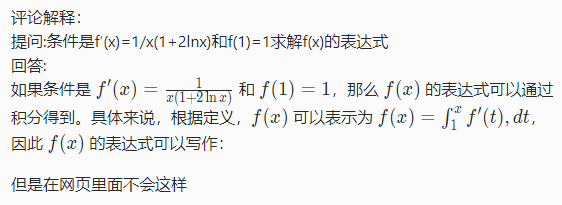

评论解释: